Microsoft는 주력 Surface Laptop Studio PC의 프로세서를 위해 NVIDIA와 협력하고 있지만, 이 회사는 AMD 가속기 Instinct M1300X 칩을 사용하기로 결정했습니다. 데이터 센터입니다.

AMD의 AI 발전 이벤트에서 이 회사는 AI 중심 GPU 및 수요를 둘러싼 최근 급증하는 NVIDIA 주도 프로세서 경쟁에 맞서기 위한 계획에 관한 수많은 뉴스를 발표하기 위해 무대에 올랐습니다.

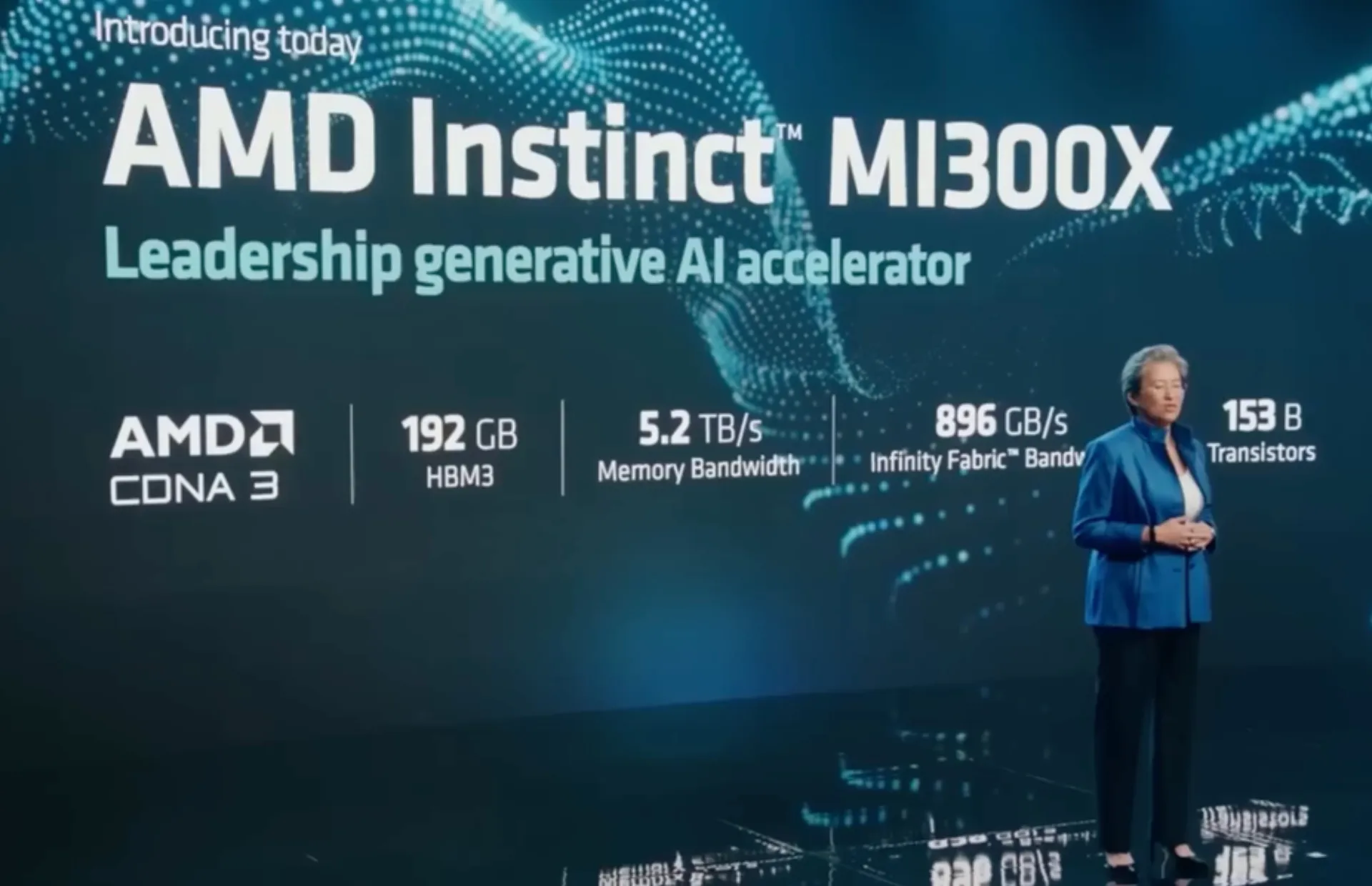

무대에서 AMD CEO Lisa Su는 Instinct MI300X GPU와 하이브리드 CPU-GPU MI300A APU를 공개했습니다. AMD는 NVIDIA의 경쟁 GPU 성능보다 1.6배 앞서 있다고 주장합니다.

부분적으로 AMD는 CDNA 3 그래픽 엔진과 결합된 24개의 Zen 4 CPU 코어와 8개의 높은 스택을 통합하는 3D 스택에 구축된 13개의 칩렛이 포함된 디자인을 포함하는 새로운 MI300 아키텍처로 주장된 우위를 달성할 수 있었습니다. – 전체 크기가 1,460억 개의 트랜지스터인 대역폭 메모리(HBM3).

Instinct M1300X에는 NVIDIA의 H100 SXM GPU 80GB HMB3 한도보다 2배 더 높은 제한에 해당하는 192GB의 HBM3가 함께 제공됩니다. AMD의 Instinct M1300은 자신의 명예에 안주하지 않고 NVIDIA가 새로 발표한 H200 칩보다 성능이 뛰어난 141GB의 HBM3e를 수용하도록 제작되었습니다.

M1300X는 AMD가 현재까지 생산한 칩 중 가장 큰 칩입니다.

성능 사다리에서 한 단계 아래로 내려간 M1300A는 128GB HBM3 메모리와 결합된 GPU 및 CPU 코어를 호스팅하고 최대 60% 더 높은 용량을 생성하는 회사 EPYC 칩과 동일한 86 기반 Zen 4 코어 아키텍처를 복사합니다. NVIDIA의 H100 GPU도 마찬가지입니다.

현재 업계 선두인 NVIDIA의 H100에 비해 성능이 향상되었다고 AMD는 자사의 M1300 AI 칩이 FP64 매트릭스 작업의 122.6테라플롭에 도달할 수 있어 H100보다 거의 80% 앞서 있다고 주장합니다.

AMD는 이미 Dell로부터 새로운 GPU에 대한 주문을 받았으며 HP, Lenovo 및 Supermicro와 같은 다른 회사는 시장 경쟁을 활용하려고 합니다.

Microsoft는 자체 OpenAI 파트너 AI 서버 칩을 개발하는 동안 AMD의 새 릴리스를 지원하는 최대 클라우드 서비스 제공업체 중 하나였습니다. M1300X를 사용하여 Azure에서 실행되는 가상 머신을 구동할 계획입니다.

답글 남기기 ▼